Être cité par les LLMs comme Chatgpt ne relève pas du hasard. Comme pour le SEO, il existe des critères qui influencent la visibilité d’un contenu dans les réponses des LLMs. On fait le point !

Résumé :

- Le référencement sur les LLM désigne l’ensemble des pratiques permettant d’apparaître comme source citée dans les réponses générées par ces modèles.

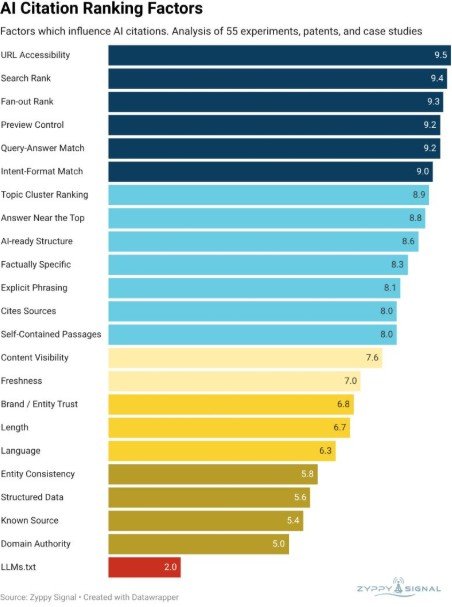

- 22 critères influencent les citations IA, selon une analyse Zyppy Signal portant sur 55 études de cas, scorés de 2 à 9,5/10.

- Les critères les plus déterminants sont l’accessibilité de l’URL, le rang de recherche Google, la qualité des métadonnées et l’adéquation contenu/intention de recherche.

- Les LLMs favorisent les contenus factuels, sourcés, structurés en passages auto-suffisants et formulés de manière explicite.

- Le fichier LLMs.txt a un impact faible sur les citations IA.

- Plusieurs outils permettent de suivre sa visibilité sur les LLM : LLM Ranking, peec AI, Scrunch AI pour une analyse native, Semrush AI Visibility et Ahrefs Brand Radar pour les équipes SEO.

Qu’est-ce qu’un LLM ?

Un LLM (Large Language Model, ou Grand Modèle de Langage) est un système d’intelligence artificielle entraîné sur des quantités massives de texte, afin de comprendre et de produire du langage humain.

Contrairement à une base de données classique qui stocke des réponses figées, un LLM génère ses réponses mot après mot, en prédisant à chaque instant ce qui a le plus de sens selon le contexte donné. Il ne “cherche” pas l’information, il la reconstruit à partir de tout ce qu’il a assimilé lors de son entraînement.

ChatGPT, Gemini, Claude ou encore Perplexity sont tous des LLMs. Des modèles aux architectures différentes, mais qui reposent sur ce même principe fondateur : apprendre les structures du langage pour mieux les reproduire.

Sur quels critères un LLM décide-t-il de vous mentionner ?

Zyppy Signal a récemment publié une analyse qui fait figure de référence dans le monde du SEO : 55 expériences, brevets et études de cas passés au crible pour identifier les facteurs qui influencent réellement les citations IA. Le résultat donne 22 critères scorés sur 10, et la première conclusion qui s’impose, c’est que le référencement sur ChatGPT ressemble beaucoup au SEO traditionnel… avec quelques nuances qui changent tout (et c’est là que ça devient intéressant).

Voir l’étude complète : https://signal.zyppy.com/p/ai-citation-ranking-factors

Les critères techniques : ceux que vous ne pouvez pas négliger

L’accessibilité de votre URL passe avant tout

Avec un score de 9,5/10, l’accessibilité de l’URL arrive en tête de tous les critères recensés. La logique est simple : si un LLM ne peut pas accéder à votre page, il ne peut pas vous citer. Cela inclut les pages bloquées par un robots.txt trop restrictif, les contenus cachés derrière un paywall, ou les temps de chargement anormalement longs. Voilà ce qu’il faut retenir : avant même de penser à votre contenu, votre site doit être techniquement lisible par les crawlers IA.

Le rang de recherche reste un signal fort

Search Rank (9,4/10) et Fan-out Rank (9,3/10) confirment que les modèles d’IA vont chercher leurs sources là où Google les place. Concrètement, si vous êtes bien positionné sur Google, vous avez statistiquement plus de chances d’être cité par ChatGPT. Ce n’est pas une coïncidence : les LLMs s’appuient en partie sur les données d’index des moteurs de recherche pour évaluer la crédibilité d’une source.

Le Fan-out Rank, lui, mesure à quel point d’autres sources de qualité renvoient vers vous. C’est l’équivalent du netlinking en SEO classique, appliqué au contexte IA.

Preview Control et contrôle de vos métadonnées

Preview Control (9,2/10) concerne la façon dont votre contenu est présenté dans les extraits et aperçus générés par les outils IA. Cela touche directement vos balises Open Graph, vos meta descriptions et la façon dont votre page est structurée pour être “prévisualisable”. Un contenu bien balisé sera mieux compris, et mieux cité.

Les critères de contenu : la vraie différence se joue ici

Répondre exactement à ce que cherche l’utilisateur

Query-Answer Match (9,2/10) et Intent-Format Match (9,0/10) forment un duo indissociable. Le premier mesure si votre contenu répond précisément à la question posée. Le second va plus loin : il évalue si le format de votre réponse correspond à l’intention de la requête.

Concrètement, ça donne quoi ? Si quelqu’un pose une question factuelle, une réponse directe en quelques phrases sera préférée à un long développement. Si la requête appelle un tutoriel, une structure étape par étape sera favorisée. L’IA ne cite pas le contenu le plus long : elle cite le contenu le plus adapté à la question.

La place de la réponse dans votre contenu compte vraiment

Answer Near the Top (8,8/10) : les LLMs favorisent les pages qui donnent la réponse dès le début, sans obliger le lecteur à scroller 3 fois. C’est aussi une bonne pratique UX, au passage (oui, les algorithmes et les humains ont parfois les mêmes préférences). Évitez les longues introductions qui tournent autour du pot avant d’arriver au vif du sujet.

Topic Cluster Ranking : être reconnu comme une référence sur un sujet

8,9/10 pour ce critère qui mesure votre autorité thématique globale. Un site qui traite en profondeur d’un domaine précis sera davantage cité qu’un site généraliste qui effleure le même sujet. C’est la logique des cocons sémantiques appliquée au référencement IA : plus votre maillage interne est solide et cohérent, plus vous êtes perçu comme une source fiable sur votre thématique.

Une structure pensée pour l’IA

AI-ready Structure (8,6/10) : votre contenu doit être techniquement lisible par un modèle de langage. Titres hiérarchisés (H1, H2, H3), paragraphes courts, informations faciles à extraire. Un contenu bien structuré est un contenu que l’IA peut “découper” et citer en extrait sans déformer votre message.

Crédibilité et précision : ce que les LLMs cherchent vraiment

La précision factuelle avant tout

Factually Specific (8,3/10) : les LLMs favorisent les contenus sourcés, chiffrés, vérifiables. Une affirmation du type “la plupart des experts s’accordent à dire que…” a beaucoup moins de valeur aux yeux d’un modèle IA qu’une donnée précise avec sa source. Plus votre contenu est factuel et traçable, plus il est citable.

Des formulations explicites qui facilitent l’extraction

Explicit Phrasing (8,1/10) : utilisez des formulations directes et non ambiguës. Les tournures implicites, les métaphores, les jeux de mots : tout ce qui nécessite une interprétation humaine sera moins bien capté par un LLM. Ce n’est pas une invitation à écrire de façon robotique, mais à formuler vos idées de manière claire et sans détour.

Citer vos sources, c’est aussi un signal de qualité

Cites Sources (8,0/10) et Self-Contained Passages (8,0/10) arrivent ex aequo. Citer vos sources renforce votre crédibilité aux yeux des modèles IA. Et des passages auto-suffisants, c’est-à-dire des sections qui font sens même sorties de leur contexte, seront plus facilement extraits et réutilisés dans une réponse IA.

Les facteurs secondaires : utiles, mais pas décisifs

Content Visibility (7,6/10) rappelle que votre contenu doit être visible : pas caché, pas conditionné à une action de l’utilisateur. Freshness (7,0/10) confirme que l’actualité du contenu joue un rôle, même si son poids reste modéré comparé aux critères de qualité structurelle.

Brand / Entity Trust (6,8/10) et Known Source (5,4/10) montrent que la notoriété de votre marque et la reconnaissance de votre site comme source fiable entrent dans l’équation, sans être déterminants seuls. Domain Authority (5,0/10) est présente, mais son poids relativement faible confirme que les LLMs ne se fient pas aveuglément à l’autorité de domaine : la qualité du contenu prime.

Length (6,7/10), Language (6,3/10), Entity Consistency (5,8/10) et Structured Data (5,6/10) complètent le tableau. La longueur compte, mais modérément. La cohérence sémantique autour d’entités (noms propres, concepts, marques) et les données structurées (schema.org) apportent un plus, sans être indispensables à eux seuls.

Et le fichier LLMs.txt dans tout ça ?

Avec un score de 2,0/10, le fichier LLMs.txt arrive bon dernier. Ce fichier, présenté par certains comme “le robots.txt des IA”, est encore trop peu pris en compte par les modèles actuels pour peser réellement dans les décisions de citation. C’est une technologie à surveiller, pas une priorité immédiate.

Gagnez en visibilité sur Google

Ne laissez pas vos concurrents prendre de l’avance. Parlons ensemble de votre stratégie SEO !

Quels sont les outils pour surveiller vos mentions dans les LLMs ?

Le marché des outils de suivi LLM évolue vite, très vite. En l’espace de deux ans, une dizaine de solutions ont émergé, avec des approches radicalement différentes. Certaines traquent vos mentions dans les réponses IA, d’autres analysent votre part de voix face aux concurrents, d’autres encore intègrent le suivi LLM à l’intérieur d’une suite SEO que vous connaissez déjà.

Pour vous aider à choisir, voici un comparatif rapide des principaux outils selon leur type et leur niveau de détail LLM :

| Outil | Type | Idéal pour | Niveau de détail LLM |

| LLM Ranking | Natif LLM | Pilotage stratégique GEO | Élevé |

| Rankscale | Natif LLM | Benchmark concurrentiel | Moyen |

| peec AI | Natif LLM | Suivi continu des mentions | Moyen |

| Scrunch AI | Natif LLM | Analyse des sources citées | Moyen (en progression) |

| Semrush AI Visibility | Suite SEO + IA | Équipes déjà sur Semrush | Basique |

| Ahrefs Brand Radar | Suite SEO + IA | Vision hybride SEO/IA | Basique |

| SearchAtlas | Suite SEO + IA | Premiers signaux IA | Basique |

| Otterly.ai | Monitoring marque | Surveillance des citations | Limité |

| Botrank.ai | Monitoring marque | Tests exploratoires / POC | Limité |

| Profound | Branding macro | Grandes marques, enjeu image | Macro |

Bon à savoir : pour une PME ou une équipe qui démarre, un combo Otterly.ai (surveillance des mentions) + Semrush AI Visibility (si déjà client) couvre l’essentiel sans multiplier les abonnements. Si votre enjeu GEO devient stratégique, LLM Ranking ou peec AI offrent une profondeur d’analyse nettement supérieure.